即將推出的 DeepSeek V4 會重蹈覆轍,還是超越歷史?DeepSeek 曾經震驚了 AI 產業,證明你不需要 1 億美元和一整個倉庫的 Nvidia H100 就能打造出與 ChatGPT 匹敵的頂尖 LLM。

但在熱潮悄然褪去後,DeepSeek 即將推出 V4 捲土重來。我們將介紹 DeepSeek V4 的發布日期、新功能和您可以期待的內容,讓您不會錯過趨勢走向。

第一部分:什麼是 DeepSeek?

DeepSeek 是一家位於中國杭州的中國 AI 研究實驗室,過去幾年一直在挑戰 OpenAI 的 ChatGPT 等 AI 巨頭。它構建並以開源許可發布大型語言模型(LLMs),令人驚嘆的是它能以如此低的運行成本提供如此高的性能。

該公司在 2025 年初發布 DeepSeek R1 時登上全球頭條,這款推理模型在數學和編程基準測試上與 OpenAI 的 o1 匹敵,據報導訓練成本約為 600 萬美元。相比之下,GPT-4 的訓練成本估計超過1 億美元。這一消息讓 NVIDIA 的市值在一天內蒸發了 6000 億美元。

儘管有如此爆炸性的開端,DeepSeek AI 的發展勢頭在這一年有所放緩。其在開源模型市場的份額從 2025 年初的約 50% 下降到年底的不足 25%。在十二個月內失去了一半的市場地位。

當前版本和即將推出的 V4 模型

隨著競爭對手快速趕上,他們在 2025 年 12 月推出了 DeepSeek V3 下的兩款新模型:DeepSeek-V3.2和DeepSeek-V3.2-Speciale,兩者都可在網頁、應用程式和 API 上免費使用。

現在,DeepSeek 據報導正在準備 DeepSeek V4。預計它將解決先前版本的弱點以及 DeepSeek 明顯落後於多模態競爭對手的領域,如視覺內容處理, AI 搜尋,以及長上下文記憶.

第二部分:DeepSeek V4 發布日期和目前所知

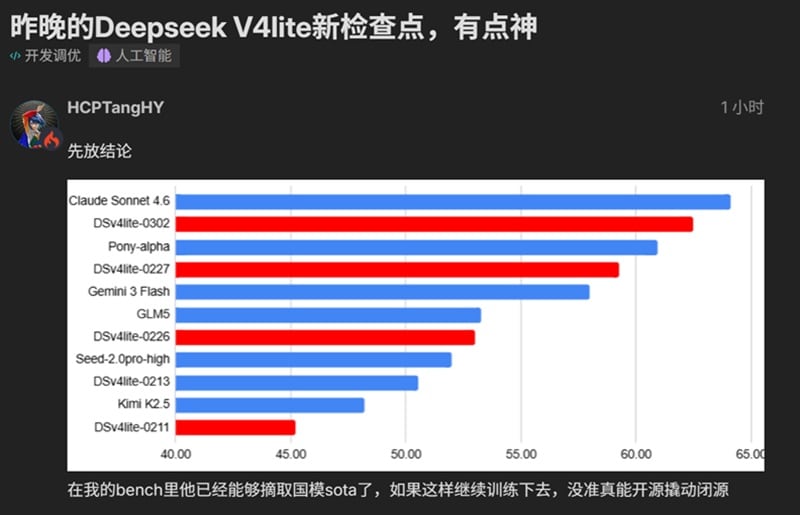

雖然許多人一直在等待,但 DeepSeek V4 的發布日期尚未得到公司本身的確認。3 月初,DeepSeek V4 Lite 曾短暫出現在平台上,引發了更大的期待。一些報告和早期討論表明它可能最早於 2026 年 4 月推出。

不過,已有關於架構和內部基準測試的洩露細節,為我們提供了更清晰的了解,V4 實際上被建構來做什麼:

- 程式編寫:據說 DeepSeek V4 的編碼性能在 SWE-bench Verified 上得分約 81%,高於 V3 的 69%,雖然尚未經過獨立驗證。憑藉 100 萬令牌的上下文視窗,該模型可以一次處理整個程式碼庫。

- 長期記憶:V4 圍繞 Engram 記憶架構構建,將事實回憶與主動推理分開。內部基準測試聲稱在百萬令牌規模下,達到 97% 的大海撈針準確率。

- 多模態:與之前僅支援文字的 DeepSeek 模型不同,V4 在預訓練期間原生整合文字、圖像和影片,而非作為附加功能。

即使有這樣的發展,在納斯達克或紐約證券交易所等主要交易所仍無法購買 DeepSeek 股票。DeepSeek 是一家中國私人 AI 初創公司,由中國量化對沖基金 High-Flyer 全資資助和擁有。它沒有公開上市,也未宣布任何相關計劃。

DeepSeek V4 預期價格

V4預計收費為 每百萬輸入令牌 0.30 美元和每百萬輸出令牌 0.50 美元。這略高於 V3.2,但仍遠低於 GPT 和 Claude 旗艦模型的定價。DeepSeek AI 聊天平台對個人用戶仍然免費。

DeepSeek V4 背後的技術

在 DeepSeek V4 所承諾的一切背後,有一系列架構升級使其成為可能。

1. MODEL1 架構

據報導,MODEL1 是 V4 的內部代號。它將 mHC 訓練框架與通過 Engram 記憶重新設計的鍵值(KV)快取相結合。結果是一個萬億參數的模型,可以在幾年前對於小得多的模型來說都不足夠的硬體上運行。它通過稀疏 FP8 解碼使 DeepSeek V4 系統效率提高,據報導記憶體使用率降低 40%,推理速度提高 1.8 倍。

2. 稀疏 FP8 解碼

V4 預設使用 FP8 運行,這是一種更輕、更快的處理格式。對於需要更高精度的任務,如複雜推理或數學運算,它可以自動切換到 FP16。您可以快速完成日常任務,而當任務要求更高時,不會犧牲準確性。

3. Engram 記憶模組

如果標準 LLM 通常在同一神經網絡中保持事實回憶和主動推理,Engram 則將它們分開。推理保留在 GPU 上以實現快速處理,而事實儲存則被壓縮並僅在需要時調用.

4. mHC 優化殘差連接

V4 能夠擴展而不增加成本的一個主要原因是 mHC。它改進了層與層之間信息移動的方式,僅增加約 6.7% 的訓練開銷。因此,您獲得了更強大的模型,而不需要在這種規模上通常預期的成本增長。DeepSeek V4 的 API 定價也能保持競爭力,儘管其規模龐大。

第三部分:DeepSeek 模型比較:R1、V3 和 V4

那麼,DeepSeek V4 與其前代產品相比如何?我們將這三個模型並排展示,讓您更容易看到每一代之間的實際變化。

| R1 | V3 | V4 | |

| 參數 | 總共 671B,活躍 37B | 總共 671B,活躍 37B | 1 兆(估計) |

| 上下文視窗 | 128K 令牌 | 128K 令牌 | 1M 令牌 |

| 編碼基準 | 與 OpenAI o1 相當 | SWE-bench Verified 69% | SWE-bench Verified 81%(估計) |

| 推理功能 | 純思維鏈推理模型 | 混合型;推理從 R1 提煉 | 混合型;通過 Engram 實現更深入的長上下文推理 |

| 多模態 | 僅文字 | 僅文字 | 文字、圖像、影片(原生) |

| API 定價(輸入) | $0.55/百萬令牌 | $0.14–$0.28/百萬令牌 | $0.30/百萬令牌 |

第四部分:如何在創意工作流程中運用 DeepSeek

DeepSeek AI 不只是一個可以問問題的聊天機器人。它可以在整個創意過程中扮演更重要的角色,例如內容創作和編碼,並承擔那些占用您大部分時間的繁重任務。

針對內容創作

- 生成結構化文章和腳本:給 DeepSeek 一個主題、目標受眾和大致方向。它會返回一個已包含標題、流程和要點的結構化草稿。您的工作只是潤飾並添加自己的聲音,而不是從白紙開始。

- 腦力激盪創意和大綱:不知道從何入手?將您的大致想法輸入 DeepSeek,並要求提供角度、切入點或大綱變化。它會給您一些具體的東西來反應,這幾乎總是比從零開始快。

用 Filmora 更快地將創意轉化為影片

如果您是以影片為最終目標的創作者,將 DeepSeek 與 AI 影片編輯器(如Wondershare Filmora )結合使用可能是您所求的完美組合。Filmora 將生成和編輯功能整合到一處,因此您剛在 DeepSeek 中建立的腳本可以直接投入製作。

雖然 V4 的原生影片功能還在等待中,但 Filmora 現在就能填補這一空缺。Filmora 能幫助您工作流程的一些功能包括:

- 腳本轉影片:將您的書面腳本自動轉換成影片草稿,包括影片素材、節奏和剪輯。將 DeepSeek AI 剛寫的腳本輸入,Filmora 會處理剩下的部分。

- 文字轉影片:從粗略的想法而不是完成的腳本開始?輸入提示,Filmora 直接從中生成短片,您可以在其多軌時間軸上進行精煉和擴展。

您還可以找到更多工具和功能,或使用 Filmora 的AI Mate 編輯作為您的助手,引導您完成編輯,生成創意,並為您處理小任務。由於它內建於影片編輯器中,整個流程都在一處進行,因此您可以從創意直接到最終輸出。

針對編碼和開發

憑藉更好的長上下文記憶和更強的基準測試結果,我們可能會看到 DeepSeek V4 成為 Claude 在編碼能力方面更經濟的替代方案。它的能力可以在幾個關鍵領域直接支持您的開發工作流程:

- 除錯和程式碼生成:貼上您有問題的程式碼並描述它應該做什麼。DeepSeek 會識別問題,解釋它,並返回修正後的版本。如果您正在開發新程式碼,也可以描述您需要的功能,讓它編寫一個可用的初稿。

- 處理大型程式碼庫:V4 的 100 萬令牌上下文視窗意味著您可以一次加載多個文件,並要求 DeepSeek 跨依賴項追蹤錯誤,解釋組件如何交互,或在考慮完整程式碼庫的情況下重構模組。

- 自動化重複性任務:DeepSeek 可以為您手動重複的任務編寫腳本,例如文件組織、數據格式化、報告生成、API 呼叫。描述您正在做的事情,它大多數時候會在第一次嘗試時返回可用的內容。

第五部分:DeepSeek 與其他 AI 模型的比較

從目前已知的洩露資訊來看,這是我們可以期待 DeepSeek V4 與 2026 年其他 AI 模型旗艦版本的比較。

| DeepSeek V4 | GPT-5.4 | Gemini 3.1 Pro | Claude Opus 4.6 | |

| 開源 | ||||

| 推理能力 | 強大,配備 Engram 記憶以提升長上下文推理 | GPQA 92.8% | GPQA 94.3% | GPQA 91.3% |

| 代理式編碼 | SWE-bench Verified ~81%(估計) | SWE-bench Verified 80% | SWE-bench Verified 80.6% | SWE-bench Verified 80.8% |

| 上下文視窗 | 1M 令牌 | 272K 令牌(標準);1M 令牌(Codex) | 1M 令牌 | 1M 令牌 |

| 輸入(每百萬令牌) | $0.3 | $2.5 | $2 | $5 |

| 輸出(每百萬令牌) | $0.5 | $15 | $12 | $25 |

| 最適合 | 成本敏感的 API 工作量、編碼、開源靈活性 | 多功能性、電腦使用、知識工作 | 博士級推理、研究、性價比 | 複雜編碼、代理工作流程、企業應用 |

| 生態系統 | 開源,可自主託管 | 最大的第三方整合 | 深度整合 Google Workspace | 強大的開發者工具(Cursor、Claude Code) |

就原始基準數據而言,這四個模型的差異比行銷宣傳所表達的更接近,在推理和編碼方面都只有 1-2 個百分點的差距。差異主要在於成本和靈活性。

特別是在 DeepSeek 與 ChatGPT 的對決中,差距最明顯的是在定價上。DeepSeek V4 的價格約為 GPT-5.4 的 1/8,但提供類似的編碼性能。ChatGPT 在生態系統規模和多功能性上仍然領先,但 DeepSeek 在保持低成本的同時,顯著縮小了品質差距。

第六部分:DeepSeek V4 在 Reddit 和社群的反應

DeepSeek V4 可能還沒發布,但在 Reddit 上快速搜索 DeepSeek V4 會發現開發者社群已經對它進行了數月的解析, r/DeepSeek目前擁有 65K 週訪問量。

大多數反應顯示興奮,而其他人則對 DeepSeek V4 消息是否如洩露所說的那麼有前景保持懷疑。畢竟,大多數被廣泛引用的基準數據(包括 81% 的 SWE-bench 分數)都源自一個被刪除的 Reddit 帖子和一條未經驗證的推文,而非 DeepSeek V4 官方論文或獨立測試。

但如果他們實現了這些目標,DeepSeek V4 可能會成為以一個讓所有其他頂尖模型難以辯解的價格點提供的最強大開源模型。

結論

我們已經分析了關於 DeepSeek V4 的所有信息。這個模型有望挑戰封閉源巨頭,並以低得多的成本幫助您處理專案。但在更多官方信息發布之前,請將您在這裡讀到的關於 V4 的所有內容視為一個有希望的線索,而非已確認的事實。

常見問題

-

DeepSeek V4 何時推出?

DeepSeek V4 發布日期的最新估計指向 2026 年 4 月。先前曾推測更早的時間窗口,但由於據報導華為昇騰 910B 硬體在訓練過程中失敗,迫使架構轉回 NVIDIA GPU,發布因此延遲。 -

DeepSeek V4 與 V3 有何不同?

V4 與 V3 的幾個關鍵升級包括:從 128K 提升到 100 萬令牌的上下文視窗、原生多模態支持,以及將事實回憶與主動推理分開的全新 Engram 記憶架構。它還擴展到萬億參數,同時通過稀疏 FP8 解碼保持低推理成本。 -

DeepSeek V4 比 ChatGPT 更好嗎?

就原始基準而言,V4 和 GPT-5.4 在推理和編碼任務上的差距僅有幾個百分點。DeepSeek 的優勢在於成本。V4 估計每令牌的價格約為 GPT 的 1/8。然而,由於 DeepSeek V4 尚未發布,目前還難以做出明確的判斷。 -

可以免費使用 DeepSeek V4 嗎?

DeepSeek 聊天平台預計將繼續對個人用戶免費,與之前版本一樣。